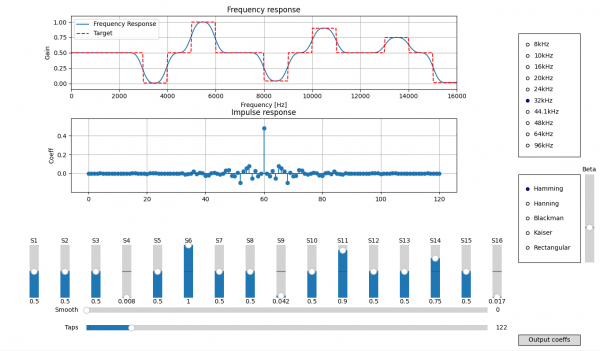

インタラクティブに設計するディジタルフィルタ

はじめに 前回の記事にて、周波数特性を直接指定してFIRフィルタを設計する方法である窓関数法のPythonコードを紹介しました。 今回は、GUIを使用してインタラクティブに設計できるようにしてみようと思います。 Pyth […]

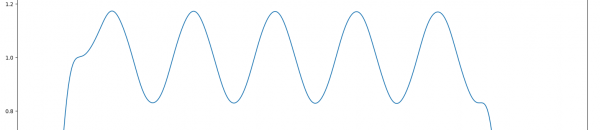

とにかくラフに設計するディジタルフィルタ

はじめに 以前に数式をほとんど使わずに理解するディジタルフィルタアナログ視点で理解するディジタルフィルタ。FIRフィルタとIIRフィルタの構造とはという記事を執筆し、ご好評をいただきました。実務上はフィルタの設計ツールを […]

CP210xシリーズのCOM番号とUSBハブ上の差し込みポートを紐づける

はじめに USBシリアル変換のICとしてすっかり定着したCP210xシリーズですが、Windowsで使う時にUSBハブ上の物理的な位置とCOM番号の関係を知りたいことはないでしょうか。 方法は簡単なのですがweb上であま […]

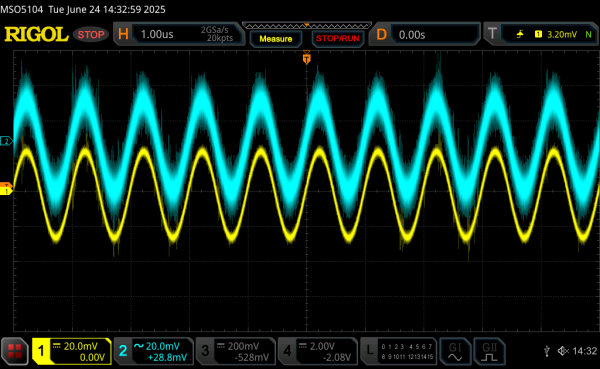

アリエク調達のアンプでアクティブプローブを作成する

はじめに オシロスコープを使っていて、アクティブプローブが欲しい場面があるでしょう。特に、電源の評価などでパッシブプローブを使うと、観測対象以外のノイズなども入りやすく、苦労するものです。 各計測器メーカーからアクティブ […]

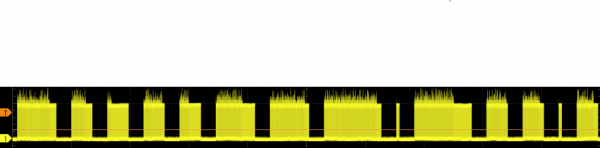

日本の3倍速!時報局BPCを受信してみた

はじめに BPCとは、中国の電波時計用に作られた時報局です。大きな特徴として、日本のJJYは1分に1フレームの情報を送りますがBPCは20秒で1フレームとなっているため日本の電波時計より3倍早く時刻合わせができることにな […]

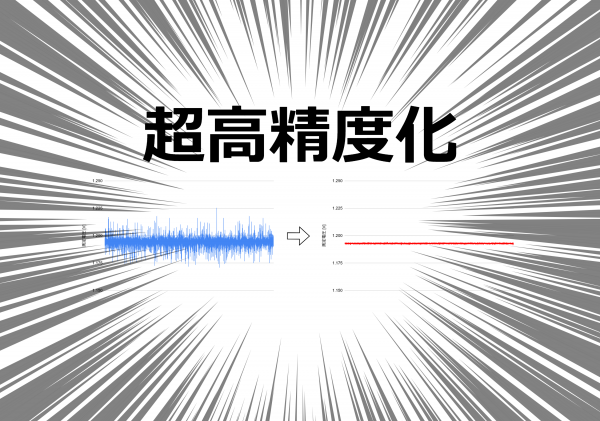

内蔵ADCを用いた高精度・高確度の電圧測定と評価

はじめに はじめまして。電気エンジニアのれいです。 今年の4月より新卒として働き始めました。 皆さんもマイコンのADCモジュールを用いてアナログ電圧の値を読み取ることがあると思います。さて、マイコンのADCを用いて読み取 […]

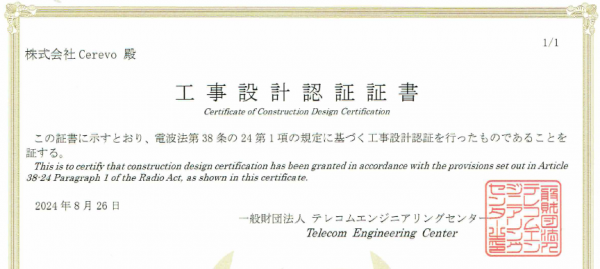

書類提出のみで工事設計認証を取得した話

工事設計認証とは 私たちが普段使う製品の中で電波を出す装置、いわゆる無線設備がとても身近な存在となりました。元来、電波を出すには一部の例外を除いて免許が必要です。なぜなら、電波は非常に貴重な資源であり有効に活用する必要が […]

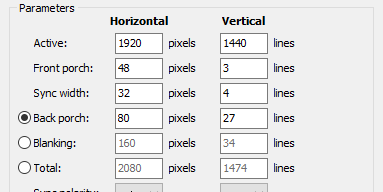

フルHD上限っぽいPCをWQHDのディスプレイにつなぐ

映像機器の開発においては様々な映像信号・解像度を扱う。そんな中で得られた面白い知見について紹介したい。 あるとき、古いPCを2560×1440px(WQHD)のディスプレイにつなぐ必要に駆られた。 CPUはAtomZ37 […]

秋月製無線給電モジュールの高性能化改造

不具合を克服した次のアプローチ 前回の記事では、ABLIC製S-8474とS-8471を使用した無線給電モジュールの問題点と解決方法を解説しました。 今回の記事では、データシートをあえて無視して給電性能のアップを試みます […]

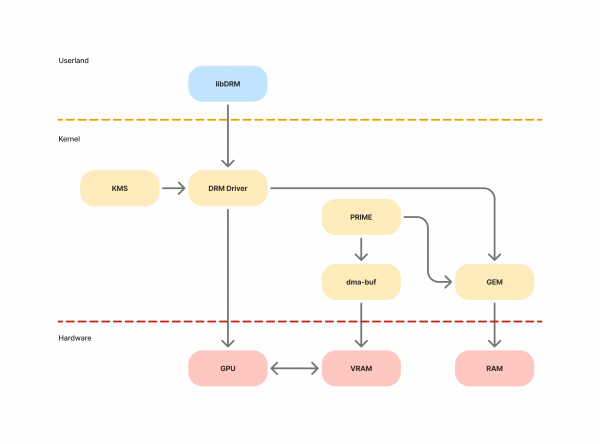

Linux kernel のDRM APIを使用して出力映像をキャプチャする方法

はじめに ソフトウェアエンジニアの福永です。ラズパイをサイネージや動画プレイヤーとして使用していると、現在再生している内容をキャプチャしたいことがままあると思います。そういった際、32bitOSではDispmanX AP […]

認証不要の小型無線給電モジュールを試す

ABLIC製ワイヤレス送電受電モジュールセットが秋月電子から発売! 2025/04/03に秋月電子から面白い商品が発売されました。小型の無線給電モジュールであり、特筆すべき点としては独自の方式により認証や電波法の制約を受 […]

アリエクガジェット分解「変身玩具」

はじめに こんにちは、電気エンジニアのたひです。 記事を書くのは2年ぶりになります。いやぁ時が経つのは早いなぁ(すっとぼけ)。まだまだ駆け出したばかりです。 今回は、アリエクを漁っていて面白そうなおもちゃを見つけたので、 […]

カデーニャカンパニー作者・たき先生がやってきた

2017年から始まったオウンドメディア、カデーニャファクトリー。2018年からカデーニャカンパニーとしてリニューアルして、現在も、家電Watchで毎週連載中のハードウェアスタートアップ企業を舞台にした、事実に基づいたフィ […]

ミニ四駆をキャタピラ化。ミニHack!基板で2個のモーターを制御して、スマホで動かす

こんにちは、Cerevoの押切です。はんだ付け不要でスマホ操作対応のミニ四駆を作れる製作キット「ミニHack!」を発売しました。 ミニHack!とは? はんだ付け不要でスマホ操作対応のミニ四駆を作れる製作キット「ミニHa […]

LiveShell WにAZDENマイクアダプターMC-1PHを接続しマイク音声2入力に

Cerevo営業の栗林です。 取引先である機材屋様のYouTubeチャンネルでCerevoのライブ配信機器「LiveShell W」を、ご紹介いただきました! AZDEN様のマイクアダプター MC-1PHと接続することに […]